EU:n tekoälyasetus ja Digital Omnibus: Tärkeimmät muutokset pähkinänkuoressa

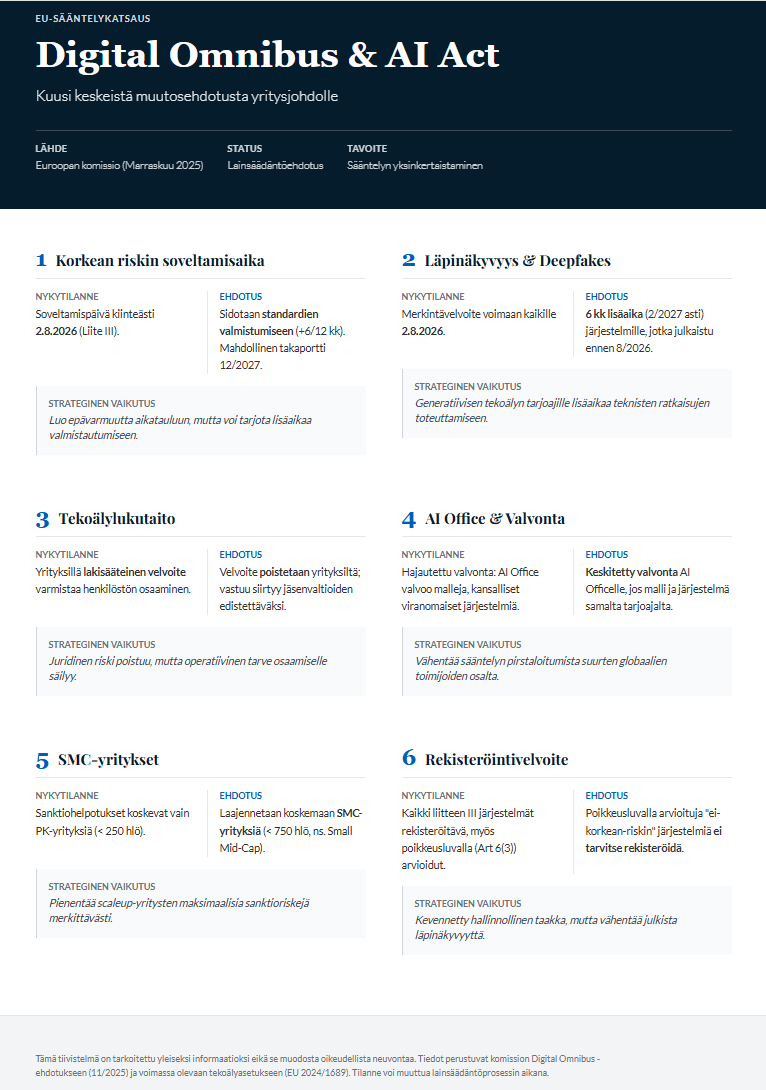

Euroopan komissio julkaisi marraskuussa 2025 Digital Omnibus -paketin, jossa esitetään kohdennettuja, mutta vaikutuksiltaan huomattavia muutoksia EU:n tekoälyasetukseen. Tässä artikkelissa esitellään kuusi keskeisintä tekoälysääntelyn muutosehdotusta ja niiden vaikutuksia yritystoimintaan.

Teemu Moilanen 7.1.2026 | Kuva: Adobe Stock Photos

Euroopan komissio julkaisi marraskuussa 2025 Digital Omnibus -paketin, jossa esitetään kohdennettuja, mutta vaikutuksiltaan huomattavia muutoksia EU:n tekoälyasetukseen (EU 2024/1689, AI Act).

Euroopan komission mukaan Digital Omnibus -paketin tavoitteena on yksinkertaistaa sääntöjä ja keventää yritysten vaatimustenmukaisuusvelvoitteita ja niihin liittyviä kustannuksia.

Tässä artikkelissa esitellään kuusi keskeisintä tekoälysääntelyn muutosehdotusta ja niiden vaikutuksia yritystoimintaan.

Kuusi keskeisintä ehdotettua muutosta

Tässä artikkelissa käsitellään kuusi tärkeintä tekoälyasetukseen (EU 2024/1689, AI Act) ehdotettua muutosta, joista yritysjohdon on hyvä olla tietoisia:

- Aikataulumuutokset korkean riskin tekoälyjärjestelmien vaatimustenmukaisuuteen.

- Aikataulumuutokset läpinäkyvyysvelvoitteiden vaatimustenmukaisuuteen.

- Tekoälylukutaitovelvoitteen ( AI literacy) lieventäminen.

- Euroopan tekoälytoimiston ( AI Office) sääntelyvaltuuksien laajentaminen.

- Suhteellisuus SMC-yrityksille (eng. small mid-cap).

- Korkean riskin tekoälyjärjestelmien rekisteröinnin rajaaminen EU:n julkisessa tietokannassa.

Kunkin kuuden muutoksen osalta artikkeli kuvaa nykyisen tilanteen, ehdotetut muutokset ja niiden vaikutukset yritysten toimintaan.

Omnibus on vasta ehdotus ja moni asia voi muuttua

Digital Omnibusista puhuttaessa on tärkeä muistaa, että kyseessä on vasta ehdotus. muuttaminen edellyttää sekä Euroopan parlamentin että jäsenvaltioiden muodollista hyväksyntää. Ehdotusta seuraavat todennäköisesti pitkät ja mahdollisesti vaikeat trilogineuvottelut komission, parlamentin ja jäsenvaltioiden välillä.

Tässä vaiheessa on vielä mahdotonta ennustaa, millainen lopullinen lakiteksti on, kuinka kauan neuvottelu- ja hyväksymisprosessi kestää, ja hyväksytäänkö tekoälyasetuksen muuttaminen lopulta ylipäätään. Samaan aikaan on kuitenkin tärkeää, että yritykset varatuvat mahdollisiin toimintaympäristön muutoksiin.

Tarkastellaan siis, mitä komission ehdotus käytännössä tarkoittaa.

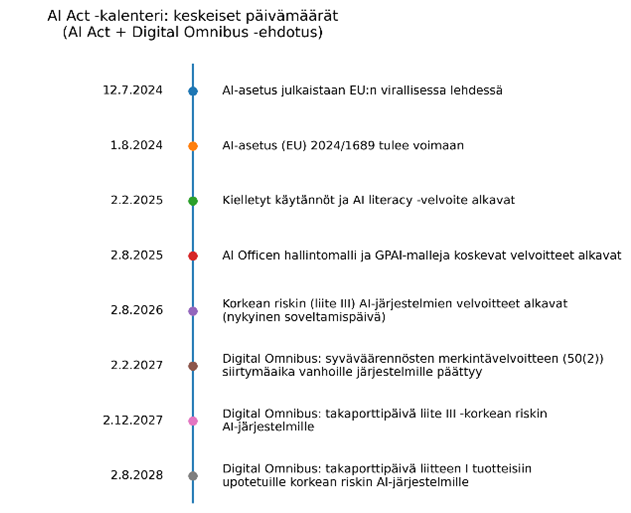

1. Aikataulumuutokset korkean riskin tekoälyjärjestelmien vaatimustenmukaisuuteen

EU:n tekoälyasetus (EU 2024/1689, AI Act) luokittelee tekoälyjärjestelmät neljään riskitasoon: kiellettyihin, korkean riskin, rajoitetun riskin ja vähäisen riskin järjestelmiin. Korkean riskin luokkaan kuuluvat järjestelmät, joilla voi olla merkittäviä haitallisia vaikutuksia ihmisten turvallisuuteen tai perusoikeuksiin. Näiden vaatimustenmukaisuus on arvioitava ennen markkinoille saattamista, ja järjestelmiä on seurattava koko niiden elinkaaren ajan.

Esimerkkejä korkean riskin järjestelmistä ovat rekrytoinnissa käytettävät työkalut, jotka analysoivat ja suodattavat työhakemuksia tai arvioivat hakijoita. Korkean riskin sovelluksia voi olla myös terveydenhuollossa (esim.diagnostiikka, potilastietojen automaatio ja kirurgia), sekä luottokelpoisuuden arvioinnissa.

Korkean riskin tekoälyjärjestelmiä koskevia säännöksiä aletaan soveltamaan2.8.2026 alkaen. Tämä tarkoittaa, että mikäli säännöksiä ei muuteta, tarjoajien ja käyttöönottajien on noudatettava korkean riskin tekoälyjärjestelmiä koskevia velvoitteita ja vaatimuksia.

Laiminlyönnistä voidaan tehdä tutkimuksia ja määrätä seuraamuksia. Soveltamispäivä koskee kuitenkin vain niitä tekoälyasetuksen (EU 2024/1689) tekoälyjärjestelmiä (esim. koulutus, työllistyminen ja HR ratkaisut, biometria sekä kriittinen infrastruktuuri), jotka saatetaan markkinoille tai otetaan käyttöön 2.8.2026 jälkeen.

Jos tekoälyasetuksen (EU 2024/1689) liitteen III mukainen järjestelmä on saatettu markkinoille tai otettu käyttöön ennen 2.8.2026, tekoälyasetuksen velvoitteet tulevat sovellettaviksi vain, jos järjestelmän suunnittelussa tai käyttötarkoituksessa tapahtuu tuon päivän jälkeen merkittävä muutos.

Lisäksi, jos korkean riskin tekoälyjärjestelmä on tuote tai tuotteen turvallisuuskomponentti, jota säännellään tietyillä liitteessä I luetelluilla EU:n tuoteturvallisuuslaeilla, soveltamispäivä on 2.8.2027.

Mitä muutoksia ehdotetaan?

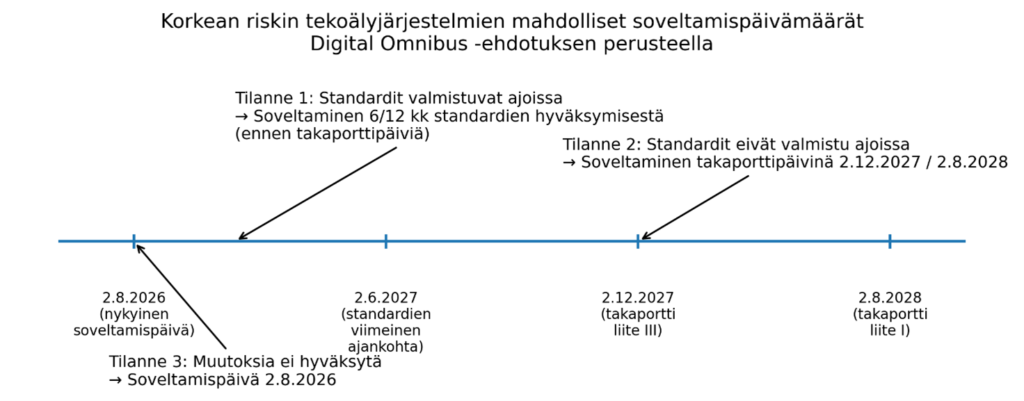

Ehdotuksen ydin onyksinkertainen: korkean riskin järjestelmiä koskevien säännösten soveltaminen sidotaan teknisten standardien ja niihin liittyvien tukityökalujen saatavuuteen. Samalla mukaan lisätään takaporttipäivät – jos standardeja ja tukityökaluja ei saada ajoissa valmiiksi ja komission hyväksymiksi, soveltaminen alkaa viimeistään tiettyinä päivinä.

Ehdotetussa mallissa on käytännössä kolme mahdollista tilannetta korkean riskin järjestelmiä koskevien säännösten voimaanastumisen päivämäärille:

Tilanne 1: Standardit valmistuvat ajoissa

Jos korkean riskin vaatimustenmukaisuuteen liittyvät tekniset standardit ja tukityökalut saadaan valmiiksi ja komissio hyväksyy ne, soveltamispäivä olisi:

- 6 kuukautta hyväksynnästä liitteessä III oleville korkean riskin tekoälyjärjestelmille; ja

- 12 kuukautta hyväksynnästä liitteessä I luetellun tuoteturvallisuuslain piiriin kuuluville tuotteille/turvallisuuskomponenteille.

Tilanne 2: Standardit eivät valmistu ajoissa

Jos standardeja ja tukityökaluja ei saada valmiiksi tai hyväksyttyä ajoissa (eli ennen alla mainittuja päivämääriä), soveltamispäivät olisivat:

- 2.12.2027 liitteen III korkean riskin tekoälyjärjestelmille; ja

- 2.8.2028 liitteen I tuoteturvallisuuslain piiriin kuuluville tuotteille/turvallisuuskomponenteille.

Tilanne 3: Muutoksia ei hyväksytä

Koska nykyinen soveltamispäivä laissa on 2.8.2026, muutosten hylkääminen tarkoittaisi, että korkean riskin järjestelmiä koskevat säännökset soveltuvat teknisesti ottaen tuosta päivästä alkaen. Tämä luo aikapaineen saada muutokset hyväksyttyä lähikuukausien aikana.

Mitä vaikutuksia näillä olisi yrityksille?

Ehdotuksessa 2.12.2027 ja 2.8.2028 toimivat takaporttipäivinä korkean riskin vaatimustenmukaisuudelle. Komissio kuvaa kokonaisuutta siirtymäaikana, joka voi olla jopa 16 kuukautta (2.8.2026–2.12.2027). Jos tekniset standardit valmistuvat liian myöhään, eli 2.6.2027 jälkeen, joka on kuusi kuukautta ennen 2.12.2027, niin tuolloin takaporttipäiviä ryhdytään soveltamaan.

Muutokset suuntaavat huomion CEN/CENELEC:n vetämään standardointityöhön. Ne korostavat, kuinka tärkeinä komissio pitää standardeja ja tukityökaluja vaatimustenmukaisuuden mahdollistamisessa.

Vaikka soveltamispäivän mahdollinen siirtyminen antaisi tarjoajille ja käyttöönottajille enemmän valmistautumisaikaa, niin tämä lisäaika luodaan varmuuden ja turvallisuuden kustannuksella. Käytännössä tämä johtaa tilanteeseen, jossa yritykset eivät enää tiedä, mikä lopullinen soveltamispäivä tulee olemaan.

2. Aikataulumuutokset läpinäkyvyysvelvoitteiden vaatimustenmukaisuuteen

Tekoälyasetuksen (EU 2024/1689) artikla 50 sisältää läpinäkyvyysvelvoitteita tiettyjen tekoälyjärjestelmien tarjoajille ja käyttöönottajille. Lisäksi se kattaa muun muassa velvoitteen ilmoittaa tekoälyn käytöstä loppukäyttäjille, merkitä syväväärennetty sisältö (eng. deepfake) ja varmistaa, että tuotokset ovat havaittavissa keinotekoisesti tuotetuiksi.

Artiklan 50(2) mukaan synteettistä ääni-, kuva-, video- tai tekstisisältöä tuottavien tekoälyjärjestelmien tarjoajien on varmistettava, että tuotokset merkitään koneellisesti luettavassa muodossa ja että ne ovat havaittavissa keinotekoisesti tuotetuiksi tai muokatuiksi.

Tätä velvoitetta aletaan soveltamaan 2.8.2026 alkaen. Soveltamispäivä koskee kaikkia tekoälyjärjestelmiä riippumatta siitä, onko ne julkaistu tai otettu käyttöön ennen vai jälkeen 2.8.2026.

Mitä muutoksia ehdotetaan?

Komissio ehdottaa, että artiklan 50(2) velvoitetta siirretään 2.2.2027 asti sellaisille tarjoajille, joiden tekoälyjärjestelmä on julkaistu ennen 2.8.2026.

Ehdotettu kuuden kuukauden lykkäys koskee vain artiklan 50(2) velvoitetta, kun taas muut artiklan 50 läpinäkyvyysvelvoitteet jäävät voimaan.

Mitä vaikutuksia näillä olisi yrityksille?

Muutos antaisi niille tarjoajille, joiden järjestelmät ovat jo markkinoilla tai otetaan käyttöön ennen 2.8.2026, ja jotka tuottavat synteettistä sisältöä, eli suurin osa generatiivisista tekoälyjärjestelmistä, kuusi (6) lisäkuukautta aikaa varmistaa, että tuotokset ovat havaittavasti tekoälyn tuottamia.

Vaikka lykkäys on suhteellisen lyhyt, se on silti komission tunnustus niistä teknisistä ja insinöörimäisistä haasteista, joita tarjoajat kohtaavat velvoitteen toteuttamisessa. Kaikkien järjestelmien, jotka julkaistaan 2.8.2026 tai sen jälkeen, on kuitenkin noudatettava velvoitetta jo julkaisusta alkaen.

3. Tekoälyn lukutaitovelvoitteen lieventäminen

Tekoälyasetuksen (EU 2024/1689) artikla 4 velvoittaa tekoälyjärjestelmien tarjoajat ja käyttöönottajat huolehtimaan tekoälylukutaidosta. Tämä on yksi lain tärkeimmistä osista, koska se on vauhdittanut niin eurooppalaisissa kuin sen ulkopuolisissakin organisaatioissa tekoälykoulutusta ja osaamisen kehittämistä.

Artikla 4 edellyttää, että henkilöstöllä ja muilla henkilöillä, jotka käsittelevät tekoälyjärjestelmien käyttöä ja toimintaa, on riittävä tekoälylukutaito.

Useimmissa yrityksissä lähes kaikki työntekijät voivat nykyään käyttää tekoälyjärjestelmiä, kuten ChatGPT:tä ja Geminia. Tämän vuoksi artiklaa 4 on perusteltua tulkita niin, että kaikille näille työntekijöille tulisi tarjota jonkinlainen tekoälykoulutus.

Tekoälylukutaitovelvoite on ollut voimassa helmikuusta 2025 lähtien. Sen rikkomisesta ei määrätä suoria seuraamuksia, mutta laiminlyönti voidaan ottaa huomioon muiden velvoitteiden valvonnassa tai tutkinnassa.

Mitä muutoksia ehdotetaan?

Komissio ehdottaa, että artiklan 4 mukainen velvoite poistetaan tarjoajilta ja käyttöönottajilta. Sen sijaan komissiolle ja jäsenvaltioille tulisi velvoite edistää tekoälylukutaitoa ja kannustaa tarjoajia ja käyttöönottajia toteuttamaan toimia riittävän tekoälylukutaidon varmistamiseksi.

Komissio viittaa siihen, että nykyinen velvoitteen avoin ja täsmentymätön luonne on aiheuttanut haasteita erityisesti pienemmille yrityksille.

Mitä vaikutuksia näillä olisi yrityksille?

Muutos olisi merkittävä, koska se poistaisi laajan ja monia organisaatioita koskevan oikeudellisen velvoitteen tekoälylukutaidon toteuttamisesta. Korkean riskin tekoälyjärjestelmien ihmisen suorittama valvonta (eng. human oversight) on kuitenkin jatkossakin kohdistettava henkilöstölle, jolla on riittävä koulutus ja osaaminen.

Siksi tekoälylukutaito on yhä välttämätöntä tässä kontekstissa. Lisäksi käytännössä on lähes mahdotonta noudattaa tekoälyasetusta — tai hallita tekoälyriskejä, skaalata tekoälyn käyttöä ja maksimoida sen arvoa — ilman tekoälyyn liittyviä koulutus- ja osaamisen kehittämisohjelmia.

Nähdäkseni on kuitenkin selvää, että edelläkävijäyritykset tuskin luopuvat tekoälylukutaito-ohjelmistaan vain siksi, ettei se ole enää lakisääteinen velvoite ja pakko. Joitakin aloitteita saatetaan kuitenkin vetää pois, pienentää, priorisoida uudelleen tai muuttaa painotusta ja laajuutta niiden suhteen.

4. Euroopan tekoälytoimiston (AI Office) valvontavallan laajentaminen

Hallinto- ja valvontaelimiä on sekä EU- että jäsenvaltiotasolla. Tekoälyasetuksen (EU 2024/1689) yksinkertaistettu yhteenveto varsin monimutkaisesta tekoälyasetuksen hallintomallista näyttää tältä:

EU-tasolla keskeisimmät toimijat ovat Euroopan tekoälytoimisto (AI Office), joka on osa komissiota, ja Euroopan tekoälylautakunta (AI Board). Tekoälytoimisto vastaa yleiskäyttöisiä tekoälymalleja koskevien säännösten valvonnasta ja täytäntöönpanosta.

Jäsenvaltiotasolla keskeisiä toimijoita ovat markkinavalvontaviranomaiset, joita voi olla useita kussakin jäsenvaltiossa. Ne vastaavat tekoälyjärjestelmiä koskevien säännösten (kuten korkean riskin ja läpinäkyvyysvelvoitteiden piirissä olevat järjestelmät) valvonnasta, tutkimuksista ja täytäntöönpanosta sekä useimmista muista tekoälyasetuksen kohdista.

Suomessa lopullinen päätös markkinavalvontaviranomaisten lukumäärästä tehdään vuoden 2025 loppuun mennessä, ja niitä tulee olemaan noin 15.

Mitä muutoksia ehdotetaan?

Komissio ehdottaa valvonnan keskittämistä suurelle joukolle yleiskäyttöisiin tekoälymalleihin perustuvia tekoälyjärjestelmiä silloin, kun sama tarjoaja kehittää sekä yleiskäyttöisen tekoälymallin että tekoälyjärjestelmän. Käytännössä tämä tarkoittaa esimerkiksi OpenAI:ta, Googlea, Anthropicia ja Metaa.

Ehdotetut muutokset tekoälyasetuksen (EU 2024/1689) artiklaan 75 tekisivät tekoälytoimistosta toimivaltaisen elimen sellaisten tekoälyjärjestelmien vaatimustenmukaisuuden valvontaan ja seurantaan, jotka hyödyntävät yleiskäyttöisiä tekoälymalleja — mutta vain silloin, kun yleiskäyttöinen malli ja tekoälyjärjestelmä ovat saman tarjoajan kehittämiä ja julkaisemia tai käyttöön ottamia.

Näissä tapauksissa tekoälytoimisto olisi yksinomaisesti toimivaltainen, eli kyseisten jäsenvaltioiden markkinavalvontaviranomaisilla ei olisi enää valvontaroolia. Tekoälytoimistolla olisi myös kaikki markkinavalvontaviranomaisen valtuudet.

Laajennus ei koske korkean riskin tekoälyjärjestelmiä, jotka kuuluvat liitteen I tuoteturvallisuuslain piiriin. Siksi muutos vaikuttaa erityisesti tekoälyasetuksen (EU 2024/1689) liitteen III korkean riskin tekoälyjärjestelmiin sekä artiklan 50 läpinäkyvyysvelvoitteiden piirissä oleviin järjestelmiin kun ne hyödyntävät yleiskäyttöisiä tekoälymalleja.

Lisäksi tekoälytoimistolla olisi yksinomainen toimivalta myös tekoälyjärjestelmiin, jotka muodostavat tai ovat integroituna nimettyyn erittäin suureen verkkoalustaan tai erittäin suureen hakukoneeseen digitaalisia palveluja koskevan asetuksen (EU 2022/2065, Digital Services Act) mukaisesti.

Mitä vaikutuksia näillä olisi yrityksille?

Komission perustelujen perusteella muutoksella pyritään poistamaan tilanne, jossa tekoälytoimisto valvoo yleiskäyttöisten tekoälymallien tarjoajia, mutta ei niitä järjestelmiä, joita samat toimijat kehittävät ja ottavat käyttöön. Komissio korostaa tarvetta tuoda kaikki tällaiset järjestelmät tekoälytoimiston valvonnan piiriin ja vähentää hallinnon pirstaloitumista.

Muutokset tekisivät tekoälytoimistosta valvontaviranomaisen monille maailman laajimmin käytetyille tekoälyjärjestelmille. Tämä johtuu siitä, että useimmat valtavirran generatiiviset tekoälyalustat kuten ChatGPT, Gemini, Claude ja Microsoft Copilot ovat yleiskäyttöisiin tekoälymalleihin perustuvia tekoälyjärjestelmiä, joissa sama organisaatio on sekä mallin että järjestelmän tarjoaja.

Tämä lisäisi selvästi tekoälytoimiston merkitystä tekoälyasetuksen valvonnassa ja täytäntöönpanossa. Se mahdollistaisi koordinoidun valvonnan sekä yleiskäyttöisten mallien, että niitä hyödyntävien järjestelmien osalta.

Se myös tarkoittaisi, että tietyt tekoälyjärjestelmien tarjoajat eivät olisi samanaikaisesti useiden jäsenvaltioiden valvontatoimien kohteena, mikä olisi mahdollista, jos lakia ei muuteta.

5. PK-yritysten suhteellisuus myös SMC-yrityksille

Tekoälyasetus (EU 2024/1689) sisältää joustavuutta ja suhteellisuutta mikro-, pienille ja keskisuurille yrityksille (PK-yritykset), mukaan lukien startupit. Esimerkiksi PK-yritysten mahdolliset sanktiot on katettu seuraavasti:

- 35 miljoonaa euroa tai 7 % maailmanlaajuisesta vuotuisesta liikevaihdosta (pienempi valitaan)

- 15 miljoonaa euroa tai 3 % maailmanlaajuisesta vuotuisesta liikevaihdosta (pienempi valitaan)

- 7,5 miljoonaa euroa tai 1 % maailmanlaajuisesta vuotuisesta liikevaihdosta (pienempi valitaan)

Tämä poikkeaa merkittävästi muille kuin PK-yrityksille sovellettavasta logiikasta, jossa valitaan aina suurempi. Käytännön tasolla tämä tarkoittaa sitä, että monet ei-PK-yritykset voisivat altistua miljardiluokan sakoille, mutta PK-yritysten sakot pysyvät aina yllä kuvatuissa rajoissa.

Muita tapoja helpottaa PK-yritysten vaatimustenmukaisuustyötä ovat mm. se, että PK-yritykset voivat toimittaa korkean riskin järjestelmien teknisen dokumentaation yksinkertaistetusti, ja että ne saavat maksutta käyttöönsä tekoälysääntelyn sääntelyhiekkalaatikoita.

Mitä muutoksia ehdotetaan?

Ensimmäinen muutos on lisätä tekoälyasetukseen oikeudelliset määritelmät PK-yritykselle ja SMC-yritykselle:

- PK-yritys on yritys, jossa on alle 250 työntekijää ja jonka liikevaihto on enintään 50 miljoonaa euroa ja/tai taseen loppusumma enintään 43 miljoonaa euroa.

- SMC-yritys on yritys, jossa on alle 750 työntekijää ja jonka liikevaihto on enintään 150 miljoonaa euroa tai taseen loppusumma enintään 129 miljoonaa euroa.

Toinen ja merkittävämpi muutos on laajentaa PK-yrityksille annettu joustavuus ja suhteellisuus myös SMC-yrityksille. Tämä tarkoittaisi, että SMC-yritykset hyötyisivät samasta rajoitetusta seuraamusjärjestelmästä kuin PK-yritykset, mikä vähentäisi olennaisesti niiden maksimaalista sakkoriskiä tietyissä tilanteissa.

Korkean riskin järjestelmien tarjoajina toimivat SMC-yritykset voisivat myös toimittaa vaaditun teknisen dokumentaation yksinkertaistetusti.

Mitä vaikutuksia muutoksella olisi yrityksille?

Draghi-raportin (2024) keskeiset teemat näkyvät komission Digital Omnibus – ehdotuksessa läpi linjan. Komissio toivoo, että sääntelyn vaatimustenmukaisuustaakan keventäminen ja täytäntöönpanoympäristön pehmentäminen laajemmalle yritysjoukolle helpottaa EU:n digistartupien ja -scaleupien kasvua, innovointia ja kansainvälistä kilpailukykyä. Draghi-raportissa todetaan nimenomaisesti, että sääntelytaakka on erityisen haitallista digialan PK-yrityksille, jotka pyrkivät skaalautumaan nopeasti.

6. Rekisteröinnin rajaaminen EU:n julkisessa tietokannassa korkean riskin tekoälyjärjestelmille

Tekoälyasetuksen (EU 2024/1689) liite III listaa kahdeksan korkean riskin tekoälyjärjestelmien luokkaa, kuten lainvalvonta (#6), koulutus ja ammatillinen koulutus (#3) sekä työllisyys, työntekijöiden hallinta ja itsenäiseen ammatinharjoittamiseen pääsy (#5). Luokittelusäännöt kuitenkin tarkoittavat, että se, että järjestelmä on tarkoitettu käytettäväksi tai sitä käytetään näillä alueilla, ei automaattisesti tee siitä korkean riskin järjestelmää.

Liitteen III järjestelmiä ei pidetä korkean riskin järjestelminä, jos voidaan osoittaa, etteivät ne aiheuta merkittävää haitan riskiä terveydelle, turvallisuudelle tai perusoikeuksille. Esimerkiksi, jos järjestelmä ei vaikuta olennaisesti päätöksentekoon tai sitä käytetään vain kapeaan menettelylliseen tehtävään, tarjoaja voi osoittaa dokumentoidulla arvioinnilla, ettei kyse ole korkean riskin järjestelmästä. Tämä poikkeus ja sen ehdot on kuvattu artiklassa 6(3) ja se koskee vain liitteen III järjestelmiä.

Tarjoajien on rekisteröitävä liitteen III korkean riskin tekoälyjärjestelmät EU:n julkiseen korkean riskin järjestelmien tietokantaan ennen kuin järjestelmät saatetaan markkinoille tai otetaan käyttöön. Kiinnostavasti rekisteröintivelvollisuus koskee nykyisin myös niitä järjestelmiä, joiden tarjoaja on artiklan 6(3) poikkeusmenettelyllä katsonut ei-korkean-riskin järjestelmiksi.

Mitä muutoksia ehdotetaan?

Komissio ehdottaa rekisteröintivelvoitteen rajaamista siten, että se ei enää koskisi järjestelmiä, jotka tarjoaja on artiklan 6(3) poikkeusmenettelyllä arvioinut ei-korkean-riskin järjestelmiksi.

Pelkistäen, jos tarjoaja on arvioinut ja dokumentoinut, että liitteen III toimialueella käytettävä järjestelmä ei ole korkean riskin järjestelmä, sitä ei tarvitse rekisteröidä EU:n julkiseen tietokantaan.

Vaikka tarjoaja voi tehdä arvioinnin itsenäisesti eikä tarvitse ulkoista hyväksyntää (esim. tekoälytoimistolta tai markkinavalvontaviranomaiselta), tarjoajan on silti velvollisuus luovuttaa arvioinnin dokumentaatio (perustelut ja näyttö) viranomaisen pyynnöstä.

Mitä vaikutuksia näillä olisi yrityksille?

Komission ehdottama muutos voi vaikuttaa ensisilmäyksellä pieneltä, mutta se olisi merkittävä yrityksille, jotka käyttävät tekoälyä laajasti liiketoiminnassaan.

Moni varmaankin yllättyi aikanaan huomatessaan, että jokainen korkean riskin toimialueella käytettävä tekoälyjärjestelmä — myös sellaiset, jotka eivät ole korkean riskin järjestelmiä, koska niitä käytetään vain avustaviin, menettelyllisiin tai valmistelutehtäviin — olisi rekisteröitävä.

Tämä olisi vaikeaa tai lähes mahdotonta hallita käytännössä, koska tekoälyä käytetään yhä laajemmin työvaiheiden tukena lähes kaikilla yritystoiminnan alueilla. Komissio kuvaa nykyistä rekisteröintivelvoitetta suhteettomaksi vaatimustenmukaisuustaakaksi.

Tämän muutoksen ilmeisimmät vaikutukset olisivat todennäköisesti:

- huomattavasti vähemmän rekisteröityjä järjestelmiä EU:n julkisessa tietokannassa,

- pienempi hallinnollinen kuorma järjestelmiä kehittäville ja käyttöönottaville organisaatioille.

Toisaalta muutos vähentäisi julkista läpinäkyvyyttä siitä, mitä järjestelmiä tarjoajat pitävät ei-korkean-riskin järjestelminä ja millä perusteilla. Tämä puolestaan voisi kannustaa joitakin tarjoajia tulkitsemaan artiklaa 6(3) laajentavasti, koska he voivat arvioida, että väärän tulkinnan riski ja siitä seuraavat sanktiot on pienempi, jos julkinen tarkastelu vähenee merkittävästi.

Mitä seuraavaksi kannattaisi tehdä?

Tässä artikkelissa käsiteltiin komission ehdottamia kohdennettuja mutta vaikutuksiltaan merkittäviä muutoksia EU:n tekoälyasetukseen. Ne ovat kuitenkin vielä ehdotuksia, ja moni asia voi matkan varrella muuttua.

Mikä siis neuvoksi? Oikeaa vastausta ei ole, mutta olen listannut alapuolelle ehdotuksia. Huomioithan, että neuvoni eivät ole juridillisia, vaan ennen kaikea kaverillisia ja kollegiaalisia.

- Seuraa trilogineuvotteluja mediasta ja pidä yrityksesi sisäinen aikataulusuunnittelu edelleen ankkuroituna 2.8.2026 päivään, koska muutos ei ole varma ennen hyväksyntää ja voimaansaattamista.

- Seuraa CEN/CENELEC-standardointityön etenemistä ja komission hyväksyntäpäätöksiä, koska ehdotuksessa soveltaminen sidotaan standardien ja tukityökalujen valmistumiseen.

- Jos toimit korkean riskin järjestelmien parissa (esim. työnhakijoiden arviointi tekoälyavusteisesti) päivitä korkean riskin järjestelmien inventaario ja luokitteluprosessi niin, että tekoälysäädöksen (EU 2024/1689) artiklan 6(3) poikkeusarviointi ja sen dokumentointi ovat selkeästi määriteltyjä ja auditoitavia.

- Tee suunnitelma artiklan 50(2) havaittavuusvelvoitteeseen: erottele ennen 2.8.2026 markkinoille saatetut järjestelmät ja sen jälkeen julkaistavat, koska soveltamispäivä voi erota niiden välillä.

- Älä lopeta tekoälylukutaitotyötä: varmista erityisesti, että korkean riskin järjestelmien ihmisen suorittama valvonta on resursoitu ja osaaminen osoitettavissa.

Lähteet

Draghi, M. (2024). The future of European competitiveness. Part A. A competitiveness strategy for Europe. European Commission. https://commission.europa.eu/document/download/97e481fd-2dc3-412d-be4c-f152a8232961_en

European Commission. (2025, November 19). Proposal for a regulation of the European Parliament and of the Council amending Regulations (EU) 2016/679, (EU) 2018/1724, (EU) 2018/1725, (EU) 2023/2854 and Directives 2002/58/EC, (EU) 2022/2555 and (EU) 2022/2557 as regards the simplification of the digital legislative framework, and repealing Regulations (EU) 2018/1807, (EU) 2019/1150, (EU) 2022/868, and Directive (EU) 2019/1024 (Digital Omnibus) (COM(2025) 837 final; 2025/0360(COD)). Publications Office of the European Union. https://eur-lex.europa.eu/legal-content/EN/TXT/PDF/?uri=CELEX%3A52025PC0837

European Commission. (2025, November 19). Annexes 1 to 2 to the proposal for a regulation of the European Parliament and of the Council amending Regulations (EU) 2016/679, (EU) 2018/1724, (EU) 2018/1725, (EU) 2023/2854 and Directives 2002/58/EC, (EU) 2022/2555 and (EU) 2022/2557 as regards the simplification of the digital legislative framework, and repealing Regulations (EU) 2018/1807, (EU) 2019/1150, (EU) 2022/868, and Directive (EU) 2019/1024 (Digital Omnibus) (COM(2025) 837 final, Annexes 1–2; 2025/0360(COD)). Council of the European Union. https://data.consilium.europa.eu/doc/document/ST-15698-2025-ADD-1/en/pdf

European Parliament and Council. (2024). Regulation (EU) 2024/1689 of the European Parliament and of the Council of 13 June 2024 laying down harmonised rules on artificial intelligence and amending Regulations (EC) No 300/2008, (EU) No 167/2013, (EU) No 168/2013, (EU) 2018/858, (EU) 2018/1139 and (EU) 2019/2144 and Directives 2014/90/EU, (EU) 2016/797 and (EU) 2020/1828 (Artificial Intelligence Act), Annex III: High-risk AI systems referred to in Article 6(2). Official Journal of the European Union, L 2024/1689, 12 July 2024. http://data.europa.eu/eli/reg/2024/1689/oj

Leinonen, E. (2024, September 5). Uusi tekoälysäädös voimaan 1.8.2024 – tiedätkö jo, mikä se on ja keitä se koskee? Lexia Asianajotoimisto. Retrieved November 24, 2025, from https://www.lexia.fi/fi/uusi-tekoalysaados-voimaan-1-8-2024-tiedatko-jo-mika-se-on-ja-keita-se-koskee/

Lång, J., Haapanen, A., Tuohino, J., Fredman, R., & Sandvik, D. (2025, November 20). Komissio ehdottaa digitaalisen sääntelyn yksinkertaistamista ja tehostamista (Digital Omnibus). Dittmar & Indrenius Attorneys Ltd. Retrieved November 24, 2025, from https://www.dittmar.fi/news/digital-omnibus/

Patel, O. (2025, November 24). How could the EU AI Act change? Enterprise AI Governance [Substack]. Retrieved November 24, 2025, from https://oliverpatel.substack.com/p/how-could-the-eu-ai-act-change

Valtioneuvosto. (2025, May 8). Hallituksen esitys eduskunnalle EU:n tekoälyasetusta täydentäväksi lainsäädännöksi (HE 46/2025 vp). Finlex. Retrieved November 24, 2025, from https://www.finlex.fi/api/media/government-proposal/690096/mainPdf/main.pdf

Teemu Moilanen

AI Consultant, yliopettaja

Finnish AI Region

+358 294471515

teemu.moilanen@haaga-helia.fi

Teemu Moilanen on palvelumuotoilija ja palvelubrändin rakentamisen asiantuntija. Moilanen on kokenut palvelumuotoilija ja palvelumuotoilun suurimman kansainvälisen kattojärjestön Service Design Networkin (SDN) akkreditoima Service Design Master.

Finnish AI Region

2022-2025.

Media contacts