Ongelma on tekoälystrategia — tai pikemminkin sen puuttuminen

Siinä vaiheessa, kun organisaatiosi on viimein päättänyt, tarvitseeko se tekoälystrategian, niin henkilöstösi on todennäköisesti jo rakentanut sellaisen. Se vain ei välttämättä ole sellainen, jonka sinä olisit halunnut — ja toisin kuin virallinen versiosi, heidän versionsa on jo käytössä.

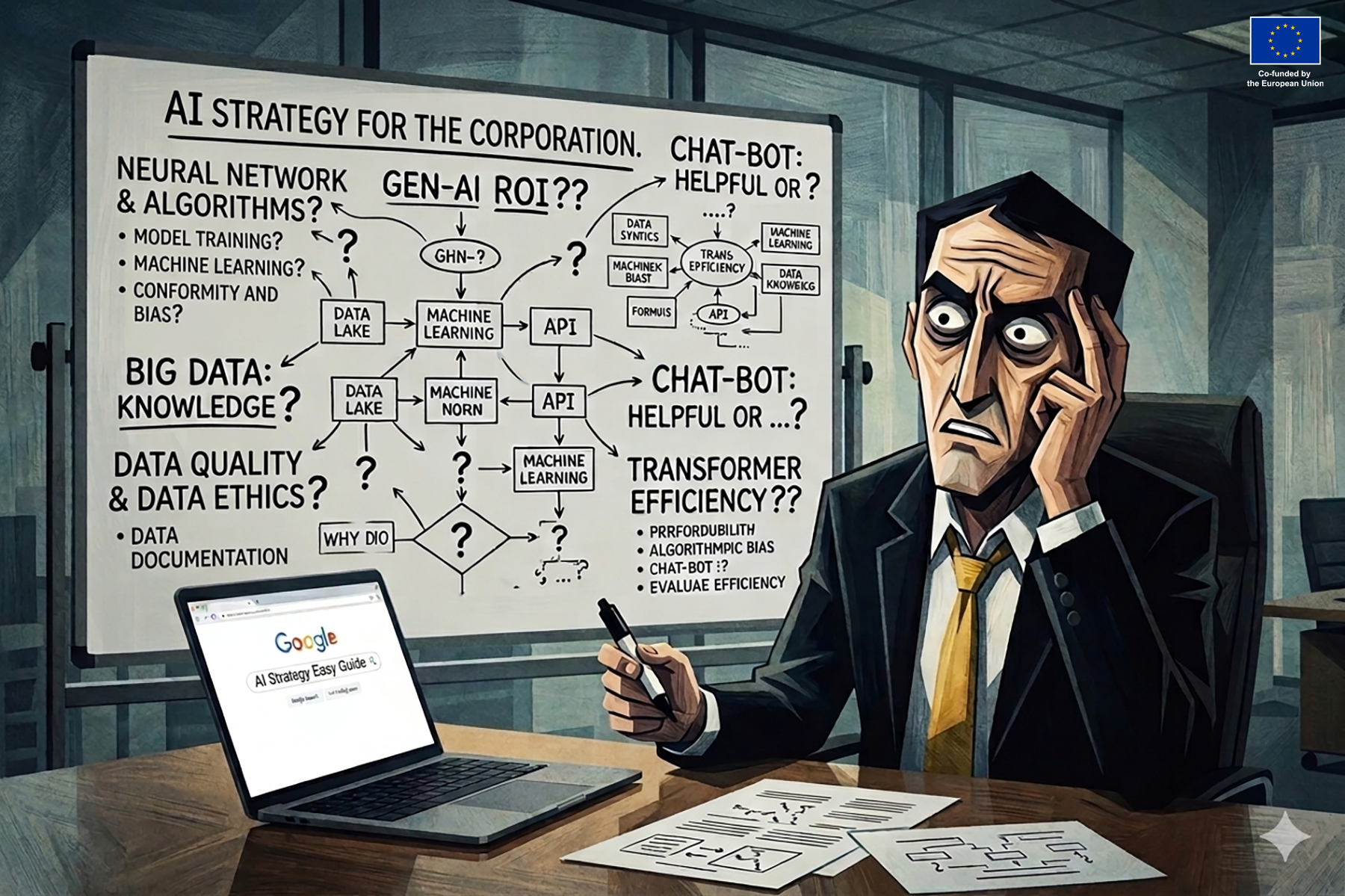

Martti Asikainen 15.4.2026 | Kuva luotu tekoälyllä

Kuvittele tavallinen maanantaiaamu. Konsulttiyrityksen asiakkuuspäällikkö liimaa ChatGPT:hen kolme sivua tapaamisen muistiinpanoja, jotka pitävät sisällään asiakkaiden nimiä, budjettilukuja ja kumppanin luottamuksellisen arvion asiakkaan henkilöstöpolitiikasta.

Yhteenveto on valmis 40 sekunnissa. Raportti lähtee 11.58.

Kaksi kerrosta ylempänä oikeusneuvonta tiivistää sopimusasiakirjoja naapurin suosittelemalla tekoälytyökalulla. HR puolestaan löysi loistavan sovelluksen ansioluetteloiden seulontaan. Kukaan ei käskenyt, mutta kukaan ei myöskään kieltänyt. Työkalut ovat toimivia, eikä mikään mene pieleen. Tai ainakaan mitään näkyvää ei tapahdu

Asiakas on tyytyväinen. Kumppani ei saa tietää. Asiakkuuspäällikkö toistaa saman vielä ensi viikolla ja sitä seuraavalla. Niin tekee myös muu organisaatio. Kun joku viimein alkaa kartoittaa virallisia tekoälytyökaluja, niin ne ovat vakiintuneet jo työtapoihin. Samalla arkaluontoista dataa on vuotanut kymmeniä kertoja.

Tämä skenaario on kuvitteellinen, mutta samalla se on myös useiden yritysten nykytila. Johdonmukainen tekoälystrategia puuttuu, ja mitä kauemmin sen kanssa viivytellään, sitä vaikeammaksi hallinta muuttuu.

Strategiavakuumi ei pysy tyhjänä

Monet yritykset pitävät tekoälystrategian puutetta neutraalina tilana, eräänlaisena taukona ennen lopullista päätöstä, mutta todellisuudessa se ei koskaan ole sitä. Strategiavakuumi täyttyy välittömästi sillä, minkä yksittäiset työntekijät katsovat hyödylliseksi, edulliseksi, työnkuluja tehostavaksi ja saavutettavaksi.

KPMG:n tutkimuksen mukaan puolet työntekijöistä käyttää tekoälytyökaluja ilman työnantajan lupaa, ja 44 prosenttia rikkoo tietoisesti yrityksen ohjeita kehittääkseen omia työnkulkujaan. Lähes yhtä moni lataa arkaluonteista yritystietoa julkisille tekoälyalustoille (KPMG 2025). Tätä ei tehdä huolimattomuudesta, vaan koska työkalut ovat aidosti hyödyllisiä, eikä yritys tarjoa työntekijöilleen hyväksyttyjä vaihtoehtoja.

Kyse ei ole työntekijöiden piittaamattomuudesta, vaan rakenteellisesta ongelmasta. Jos johto ei tarjoa työkaluja, ohjeistusta ja kehystä tekoälyn vastuulliseen käyttöön, niin eivät työntekijät silti lopeta sen käyttöä. He jatkavat, mutta toimivat näkymättömästi, ilman suojakaiteita ja jaettua ymmärrystä riskeistä.

Tätä ilmiötä kutsutaan varjotekoälyksi. Siitä puhutaan ensisijaisesti tietoturva- ja tietosuojariskien näkökulmasta (Khan & Asikainen 2026), mutta se on myös merkki paljon syvemmästä ongelmasta. Työntekijät, jotka kurkottavat virallisten kanavien ulkopuolelle, pyrkivät ratkaisemaan todellisia ongelmia käytettävissään olevilla resursseilla. Yritys on vain päättänyt, ettei se ole yksi niistä resursseista.

Mitä kauemmin, sitä vaikeampaa

Tekoälystrategian kanssa viivyttely on enemmän kuin menetetty mahdollisuus, sillä varjotekoäly ei odota, vaan kasvaa korkoa. Jokainen viikko ilman strategiaa on viikko, jolloin uudet työnkulut vakiintuvat, työkaluriippuvuudet syntyvät ja työskentelytavat muodostuvat.

Markkinointitiimi, joka on käyttänyt tiettyä tekoälytyökalua kuusi kuukautta, on rakentanut koko sisällöntuotantoputkensa sen varaan. Sen kieltäminen tai korvaaminen ei ole enää strateginen päätös, vaan muutosjohtamisen haaste. Silloin et esittele uutta työkalua, vaan pyydät ihmisiä luopumaan jostakin, joka on helpottanut heidän arkeaan, ilman takuuta paremmasta.

Sama toistuu osastosta toiseen. Jokainen niistä kehittää oman epävirallisen tekoälykulttuurinsa, omat suosikkityökalunsa ja omat kiertotiensä. Kun virallinen strategia viimein valmistellaan, niin yritys ei aloita tyhjältä pöydältä. Se pyrkii asuttamaan alueen, joka on jo asutettu epätasaisesti ja ilman hallintakehyksiä.

Tämä ei silti ole syy luovuttaa, vaan pikemminkin syy aloittaa nyt. Strategia kannattaa rakentaa todellisen tilanteen pohjalta, ei sen pohjalta, missä yritys toivoisi olevansa, sillä aika ei ole enää puolellasi.

Investointiloukku

Deloitten vuoden 2026 State of AI in the Nordics -raportti tekee ongelman konkreettiseksi. Sen mukaan 76 % pohjoismaisista organisaatioista suunnittelee kasvattavansa tekoälyinvestointejaan merkittävästi tänä vuonna. Samalla strateginen valmius on laskenut 61 prosentista 43 prosenttiin ja osaamisen valmius romahtanut 33 prosentista 14 prosenttiin vuodessa (Deloitte 2026). Kuluttaminen kiihtyy juuri silloin, kun valmiudet heikkenevät.

Raportin selitys on suoraviivainen. Organisaatiot, jotka ottivat käyttöön valmiita generatiivisen tekoälyn työkaluja, kehittivät samalla väärän valmiuden tunteen. Operatiivinen integraatio paljasti, että työkalujen käyttöönotto ja henkilöstön kyvykkyyden rakentaminen ovat pohjimmiltaan hyvin erilaisia haasteita, eikä infrastruktuurin luominen ollut koskaan se vaikeampi osuus.

Tilannetta pahentaa vastuun puute. Deloitten raportin mukaan vain 20 prosenttia pohjoismaisista organisaatioista on nimennyt jonkun vastaamaan siitä, tuottaako tekoäly tuloksia, kun globaalilla tasolla luku on 32 prosenttia (Deloitte 2026). Toisin sanoen neljässä viidestä pohjoismaisesta organisaatiosta kukaan ei ole vastuussa siitä, toimiiko mikään oikeasti. Investointi ilman vastuuta ei kuitenkaan ole strategia. Se on optimismia budjetilla.

Liian myöhään saapuva strategia

Mielestäni on tärkeää nimetä yksi erityinen epäonnistumisen muoto, jotta jokainen voisi välttää sudenkuopan. Tämä koskee sellaisia yrityksiä, jotka viivyttävät tekoälystrategiaansa, ja kompensoivat puutetta tuottamalla jotain muodollista ja hidasta. Strategiaa varten perustetaan komitea, joka laatii kehyksen. Samaan aikaan palkataan konsultteja, jotka luovat asiakirjoja, jotka ovat perusteellisia, huolella muotoiltuja ja täysin irallaan todellisuudesta.

Tämä strategiatyyppi tai strategian muodostamisen tyyppi ei korvaa varjotekoälyä. Se elää sen rinnalla, suurelta osin huomiotta, koska siinä ei käsittellä niitä työkaluja, joita ihmiset oikeasti käyttävät työssään, ja niitä työnkulkuja, joita he ovat itse kehittäneet nopeuttaakseen työtään. Se ei myöskään ratkaise niitä ongelmia, joita työntekijät yrittivät itse ratkaista kurkottaessaan hyväksymättömien tekoälyavustajien puoleen.

Kysymys ei näin ikään ole pelkästään siitä, pitääkö strategia olla, vaan siitä, heijastaako se organisaation todellisuutta vai ainoastaan sen toiveita. Useimmat sudenkuoppaan astuneet tietävät jo vastauksen. Asiakirja on olemassa. Komitea kokoontui. Kehys hyväksyttiin. Mutta juridiikan ihminen käyttää edelleen naapurin suosittelemaa työkalua. Tietäminen ei ole ongelma. Toimiminen sen pohjalta on.

Ihmiset, jotka tietävät jo vastauksen

Yksi tyypillisimmistä virheistä tekoälystrategian kanssa on tilanne, jossa työntekijöiden kokemukset jätetään huomiotta. Työntekijät ovat jo käyttäneet tekoälytyökaluja epävirallisten kanavien kautta, jolloin he ovat myös tehneet merkittävän osan strategian taustalla olevasta työstä – jos heitä vain kuunnellaan.

He tietävät, mitkä tehtävät aidosti paranevat tekoälyavusteisesti ja missä malli tuottaa vakuuttavan kuuloista tekstiä, joka silti vaatii ihmistä korjaamaan virheet. He tietävät, mitkä työkalut sopivat heidän työnkulkuihinsa ja mitkä osoittautuivat käytössä hyödyttömiksi. He myös tietävät, missä aika säästyy oikeasti.

Tätä tietoa ei lähes koskaan kerätä. Se istuu yksittäisissä työnkuluissa, jaetuissa kansioissa ja Slack-langoissa. Strategiaprosessi sisältää ylimmän johdon, teknologiatiimin ja ehkä pari ulkopuollista konsulttia. Nämä kaikki ovat ihmisiä, jotka ovat tehneet huomattavasti vähemmän käytännön tekoälytyötä kuin henkilöstö yleisesti ottaen.

Henkilöstön käyttökokemusten sulkeminen strategiatyön ulkopuolelle ei ole pelkästään menetetty mahdollisuus, vaan myös hallintovirhe. Ilman henkilöstön panosta rakennettu strategia nojaa olettamuksiin siitä, miten työ tapahtuu, eikä siihen, miten työ oikeasti tapahtuu. Ironia on siinä, että ne samat ihmiset, joiden laiton työkalujen käyttö luon ongelman ja riskit, ovat myös tehokkain keino sen ratkaisemiseen.

Käänne, jonka strategiat sivuuttavat

Perinteinen tapa ottaa niskalenkki strategiahaasteesta on tarttua sen kehykseen: auditoi nykyinen käyttö, tunnista riskiluokat, muuta henkilöstöpolitiikkaa ja kouluta henkilöstöä. Kaikki tämä on välttämätöntä, muttayksinään se ei riitä. Ensisijaisesti riskien lieventämiseen rakennettu tekoälyhallinto tuottaa ympäristöjä, joissa työntekijät tietävät selvästi, mitä he eivät saa tehdä, mutta vain hämärästi sen, mitä he saavat.

Lista kielletyistä alustoista ja lauseke arkaluonteisesta datasta ovat rajoitejärjestelmiä, eivät kyvykkyysjärjestelmiä. Se vähentää näkyvimpiä riskejä, mutta jättää taustalla olevan dynamiikan muuttumattomaksi. Deloitten havainnot tekevät tämän näkyväksi. Pohjoismaisissa organisaatioissa, joissa vähintään 40 prosentilla henkilöstöstä on pääsy hyväksyttyihin tekoälytyökaluihin, käyttöaste kasvoi 37 prosentista 56 prosenttiin vuodessa (Deloitte 2026).

Merkittävä kasvu, mutta samana ajanjaksona sekä strateginen että osaamisen valmius laskivat jyrkästi. Laajempi pääsy ilman kyvykkyyttä, omistajuutta ja strategista selkeyttä ei ole mahdollistamista, vaan se on leviämistä, jonka mukana leviävät myös varjotekoälyt. Tämän hallitsevat yritykset tuottavat hyväksyttyjä vaihtoehtoja työnkulkuihin, jotka ovat oikeasti parempia kuin luvattomat. Työkaluja, jotka saavuttavat työntekijät siellä, missä he ovat ja hoitavat datahallinnon ilman, että taakka lankeaa yksilön harteille.

Odottamisen hinta ja johtopäätökset

Päätös viivyttää tekoälystrategiaa kehystetään usein varovaisuudeksi. Eräänlaiseksi vastuulliseksi valinnaksi odottaa, kunnes teknologian maturiteetti on saavuttanut tietyn tason tai sisäinen konsensus on löydetty. Mitä tämä kehystys ohittaa, on se, että viivytyksellä on kustannuksia. Niitä ei makseta tulevaisuudessa, vaan tälläkin hetkellä esimerkiksi datana, joka on vuotanut ulos, päätöksinä, jotka perustuvat varmentamattomiin tekoälytuotoksiin, ja kasvavana kuiluna tekoälyn virallisen aseman ja sen todellisen käytön välillä.

Varjotekoälytapaukset maksavat yrityksille huomattavasti enemmän kuin tavalliset tietoturvapoikkeamat. Tämä johtuu ensisijaisesti siitä, että selvittämiseen kuluu aikaa: mitä dataa oli mukana ja kenellä oli siihen pääsy (Zorz 2026). EU:n tekoälyasetus, joka astuu kokonaisuudessaan voimaan elokuussa 2026, asettaa yrityksille velvoitteen varmistaa riittävä tekoälylukutaito ja asianmukainen hallinto (EU 2024/1689). Näiden velvoitteiden täyttäminen on sula mahdottomuus ilman toimivaa tekoälystrategiaa.

Pohjoismainen malli tekee panokset konkreettisiksi. Deloitten mukaan pohjoismaiset yritykset suoriutuvat globaaleja verrokkeja paremmin teknisessä infrastruktuurissa, mutta niiden strateginen valmius ja osaamisen valmius romahtavat samanaikaisesti (Deloitte 2026). Tämä antaa viitteitä siitä, ettei tekninen valmius tuota strategista koherenssia. Se vain tekee kyvykkyyden ja suunnan välisen kuilun kalliimmaksi.

Kun kuulet seuraavan kerran kokouksessasi jonkun sanovan, ettei heidän tekoälystrategiansa ole vielä valmis, niin kysy yksinkertainen ja herättävä kysymys: mitä ihmiset tekevät sillä välin, kun he odottavat? Sinä tiedät kyllä tähän vastauksen, mutta tietävätkö muut samassa pöydässä istuvat, jotka suunnittelevat tekoälystrategiaanne.

Lähteet

Deloitte. (2026). State of AI in the Nordics: Deloitte’s State of AI in the Enterprise report series — Nordic cut. Deloitte AI Institute.

European Union. (2024). Regulation (EU) 2024/1689 of the European Parliament and of the Council laying down harmonised rules on artificial intelligence (Artificial Intelligence Act). Official Journal of the European Union.

Khan, A. U. & Asikainen, M. (2026). How (Not) to Destroy Your Business with AI. Finnish AI Region. https://www.fairedih.fi/en/2026/02/05/how-not-to-destroy-your-business-with-ai/

KPMG. (2025). Trust, attitudes and use of artificial intelligence: A global study 2025. KPMG International.

McKinsey & Company. (2025). The state of AI in 2025: Agents, innovation, and transformation. McKinsey Global Institute.

NIST. (2023). Artificial intelligence risk management framework (AI RMF 1.0). National Institute of Standards and Technology.

Zorz, M. (2026). AI went from assistant to autonomous actor and security never caught up. Help Net Security. https://www.helpnetsecurity.com/2026/03/03/enterprise-ai-agent-security-2026/

Tekijä

Martti Asikainen

Communications Lead

Finnish AI Region

+358 44 920 7374

martti.asikainen@haaga-helia.fi

Finnish AI Region

2022-2025.

Media contacts