Oikeudenmukainen mutta kylmä — algoritminen johtaminen työelämässä

Algoritminen johtaminen lupaa tehokkuutta, skaalautuvuutta ja datapohjaisia päätöksiä. Usein se myös pitää lupauksensa. Ongelma ei ole siinä, mitä algoritmit tekevät, vaan siinä, mitä ne eivät yleensä tee. Ne eivät kuuntele. Ne eivät selitä. Eivätkä ne välttämättä vastaa.

Teksti: Martti Asikainen, 5.5.2026 | Kuva: Adobe Stock Photos

Algoritminen johtaminen on yleistynyt vauhdilla. OECD:n työnantajakyselyssä (2025) yhdysvaltalaisista yrityksistä jo 90 % kertoi hyödyntävänsä algoritmisia johtamisjärjestelmiä. Euroopassa luku on 79 prosenttia. Suomessa lähes joka toinen asiantuntija- ja tietotyöntekijä kertoo omaavansa kokemuksia koneohjatusta johtamisesta (Asikainen & Lahtinen 2025).

Koneohjatuille johtamisjärjestelmille, eli algoritmiselle johtamiselle, on hyvä perustelut. Ne skaalautuvat, ne eivät väsy, eikä niillä ole suosikkeja. Kun algoritmi mittaa suoriutumista, se mittaa kaikkia työntekijöitä samoilla parametreilla. Tämä on lupaus, joka houkuttelee monia. Ei siis ihme, että algoritmiseen johtamiseen törmää päivittäin muun muassa työvuorosuunnittelussa, suoritusmittauksessa ja tehtävien jaossa.

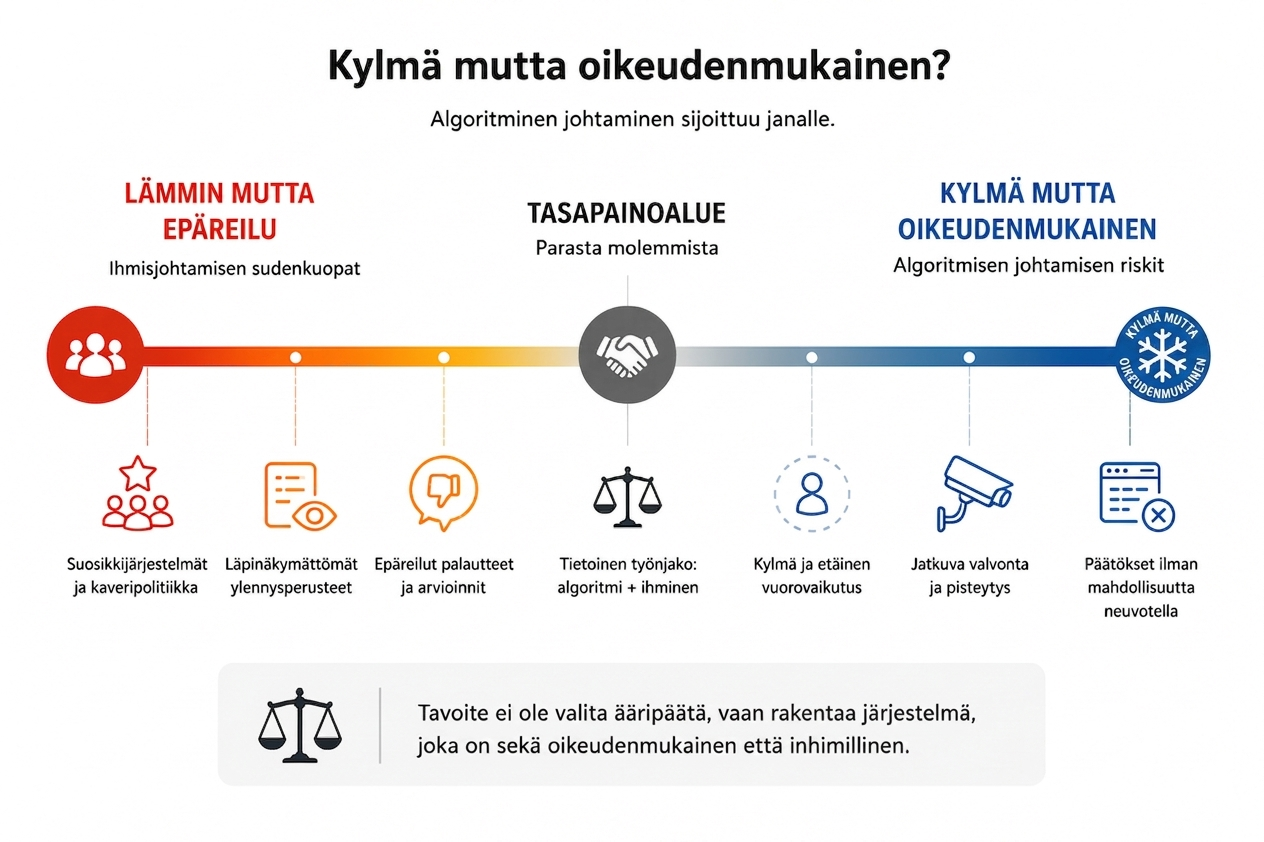

Algoritmia ei kiinnosta, mitä jääkiekkojoukkuetta kannatat, kuinka monta työntekijää sen täytyy paimentaa ja mihin kellonaikaan. Sen työpanos ei myöskään ole riippuvainen mielialoista, eikä sen toimintaan vaikuta terveysongelmat ja organisaation sisäiset skismat. Tehokkuus ja oikeudenmukaisuus ovat eri asia. Järjestelmä voi olla jompaakumpaa, mutta vain harvoin molempia. Toisaalta paljon se riippuu myös siitä, miten se on rakennettu, mihin tarkoitukseen ja kenen intresseistä käsin.

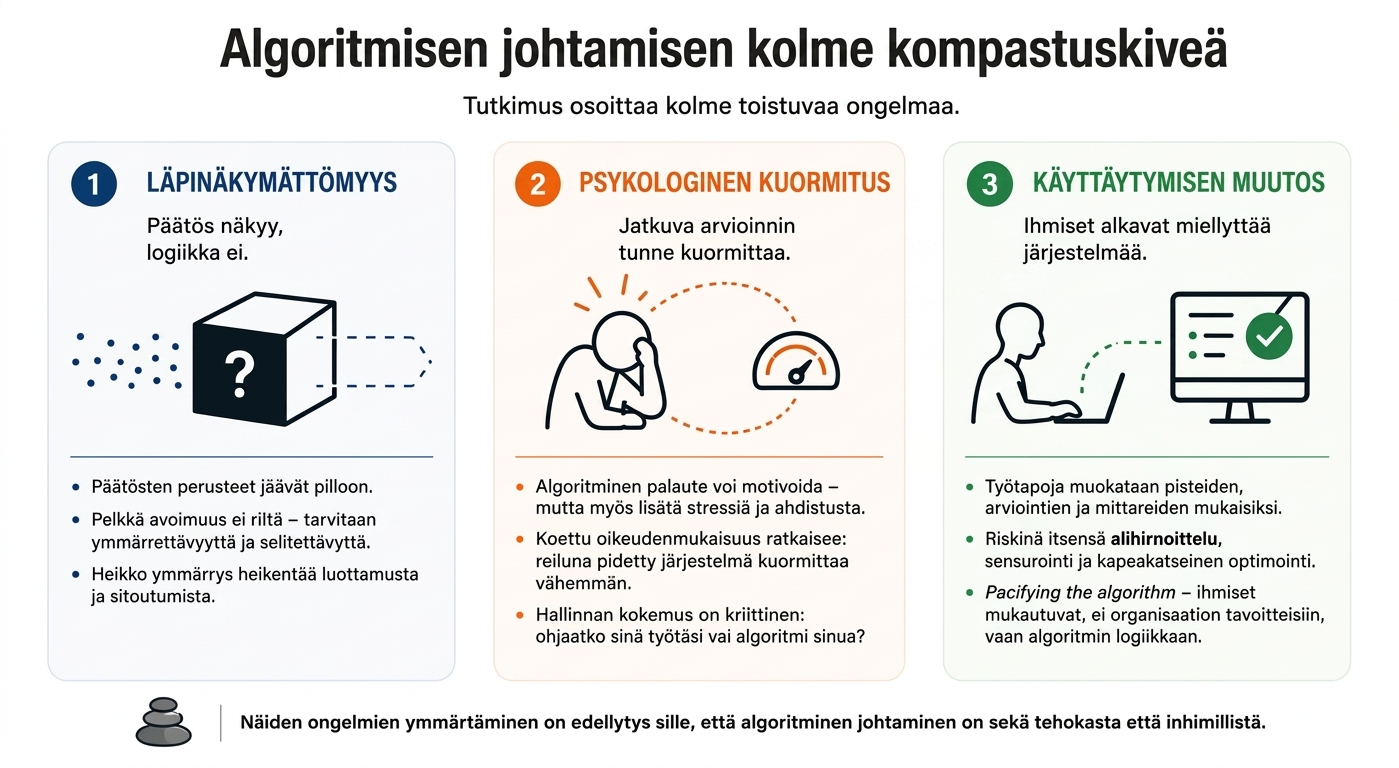

Kolme eri kompastuskiveä

Tutkimuskirjallisuus algoritmisesta johtamisesta on laajaa mutta hajanaista. Yhtenäistä teoriaa ei ole vielä muodostunut, ja eri tutkimuslinjat puhuvat usein ohi toisistaan (esim. Kellogg et al. 2020; Meijerink & Bondarouk 2023). Tämä pirstaleisuus ei ole vain teoreettinen ongelma, vaan se heijastuu myös käytäntöön, jossa algoritmisia järjestelmiä otetaan käyttöön ilman vakiintunutta ymmärrystä niiden vaikutuksista.

Kirjallisuudesta nousee silti esiin kolme toistuvaa teemaa. Ensimmäinen on läpinäkyvyyden puute. Algoritminen johtaminen toimii parhaimmillaan kuin hyvä esihenkilö: johdonmukaisesti, ennustettavasti ja perustelut tarjoten. Pahimmillaan se puolestaan toimii mustana laatikkona, jossa päätökset syntyvät, mutta logiikka jää piiloon. Alan kirjallisuus korostaa, että pelkkä avoimuus ei riitä, sillä ratkaisevaa on ymmärrettävyys ja selitettävyys (Ananny & Crawford 2018; Lee et al. 2015). Työntekijän kyky hahmottaa järjestelmän logiikka vaikuttaa suoraan sitoutumiseen ja luottamukseen (Rosenblat & Stark 2016).

Toinen teema on psykologinen kuormitus. Algoritminen palaute näyttäytyy tutkimuksissa sekä motivoivana haasteena että lamaannuttavana esteenä. Kriittinen tekijä on yksilön hallinnan kokemus eli ohjaatko sinä työtäsi vai ohjaavatko algoritmit sinua. Lyhytaikaisia ja keikkaluonteisia töitä koskeva tutkimus dokumentoi toistuvaa stressiä ja jatkuvaa arvioinnin kokemusta (Wood et al. 2019), mutta myös tilanteita, joissa selkeä palaute ja tavoitteet lisäävät motivaatiota (Kellogg et al. 2020). Koettu oikeudenmukaisuus nousee kirjallisuudessa keskeiseksi välittäväksi tekijäksi. Järjestelmä, jota pidetään reiluna, kuormittaa vähemmän riippumatta sen teknisistä ominaisuuksista (Colquitt et al. 2001; Meijerink & Bondarouk 2023).

Kolmas teema on käyttäytymisen muutos. Oslon yliopiston professori Taina Bucher kuvaa ilmiötä nimellä pacifying the algorithm, joka tarkoittaa tilannetta, jossa ihmiset oppivat, miten järjestelmä arvioi heitä, ja alkavat optimoimaan toimintaansa sen logiikan mukaisesti (Bucher 2018). Käytännössä tämä näkyy työtapojen muokkaamisena, kuten esimerkiksi itsensä alihinnoitteluna ja käyttäytymisen sensurointina (Carnegie 2022). Vastaavaa on havaittu sekä alustatyössä että perinteisemmissä organisaatioissa (Kellogg et al. 2020).

Ilmeinen ratkaisu ei ole riittävä

Näiden kolmen ongelman pohjalta yksinkertaisimpaan selitykseen on helppo tarttua: avaa algoritmit, tee niistä läpinäkyviä, niin ongelma ratkeaa. EU:n tekoälyasetus (2024/1689) menee tähän suuntaan, kun se edellyttää, että korkean riskin järjestelmien — mukaan lukien työnhakuun ja henkilöstöhallintaan liittyvät sovellukset — on oltava selitettäviä ja auditoitavia. Sääntely on tarpeen, mutta se tuskin yksin riittää kasvattamaan ymmärrystä, luomaan turvallisuutta tai vaikuttamaan käyttäytymiseen.

Ananny ja Crawford (2018) tekivät tästä tärkeän erottelun artikkelissaan Seeing without knowing. Heidän mukaansa näkeminen ei ole sama asia kuin ymmärtäminen. Voit saada käyttöösi algoritmin koodin, sen painotukset ja parametrit, ja silti olla täysin ymmällä siitä, miksi se teki juuri sinulle juuri tämän päätöksen. Läpinäkyvyys ilman tulkintaa ja kontekstia on kuin saisi lääkäriltä sairaskertomuksensa latinaksi.

Amazon tarjoaa tästä oivan esimerkin. Sen järjestelmät ovat dokumentoituja, auditoituja ja monelta osin selitettyjä. Tästä huolimatta työntekijät kuvaavat ympäristöä ahtaaksi ja valvotuksi — jotkut vertaavat työpaikkan kyttäyskulttuuria jopa vankilaan (Palmer 2020; Sainato 2024; Bansal 2026). Wood ym. (2019) ovatkin osoittaneet, että algoritminen johtaminen tuo mukanaan sekä autonomiaa että kontrollia, samaan aikaan ja saman järjestelmän sisällä — eikä tämä kaksiteräisyys häviä mihinkään läpinäkyvyyden lisääntyessä.

Kysymys ei siis ole pelkästään avoimuudesta, vaan myös vallasta. Siitä, kenellä on oikeus haastaa päätös, kenellä on pääsy dataan, ja kuka vastaa, kun algoritmi tekee virheen. OECD:n vuonna 2025 julkaistussa kyselytutkimuksessa lähes kaksi kolmesta algoritmista johtamista käyttävästä esihenkilöstä raportoi vähintään yhden huolen järjestelmien luotettavuudesta. Yleisin huoli liittyi epäselvään vastuukysymykseen tilanteissa, joissa algoritminen järjestelmä johti virheelliseen päätökseen.

Kun vastuu hajautetaan järjestelmään, se ei suinkaan katoa, vaan muuttuu näkymättömäksi. Johtaja voi vedota siihen, että järjestelmä on päättänyt jotain, mutta järjestelmä itsessään ei voi puolustautua tai sanoa tähän yhtään mitään. Työntekijä jää helposti täysin yksin päätöksen kanssa, jonka alkuperää ei voi jäljittää tai osoittaa kenellekään. Tätä ongelmaa ei pysty korjaamaan avaamalla lähdekoodia, vaan se vaatii aitoa kohtaamista.

Työntekijän saadessa päätöksen, jota hän ei ymmärrä (esim. vuoron peruutuksen, arviointipisteiden laskun, sopimuksen päättämisen), hän ei etsi ensisijaisesti selitystä. Hän etsii ihmistä, jolle voi sanoa, ettei tämä ole oikein. Algoritmi ei voi kuulla tätä. Se ei voi epäröidä, pahoitella tai muuttaa mieltään. Se on läsnä kaikkialla datan tasolla ja poissa sieltä, missä kokemus syntyy. Tämä on ongelmallista, koska johtaminen on pohjimmiltaan kohtaamisia. Erilaisia tilanteita, joissa kaksi ihmistä neuvottelee siitä, mikä on reilua ja mikä ei. Kun toinen osapuoli korvataan algoritmisella järjestelmällä, niin neuvottelu lakkaa ja jäljelle jää vain päätös, jonka kanssa on pakko elää. Tästä syystä on erityisen tärkeä löytää balanssi algoritmisen ja ihmisjohtamisen välillä.

Kylmä mutta oikeudenmukainen

Haaga-Helia ammattikorkeakoulun viime vuonna toteuttamassa kyselytutkimuksessa suomalaiset työntekijät antoivat algoritmiselle johtamiselle yllättävän myönteisiä arvioita (Asikainen & Lahtinen 2025). Kyselyyn vastasi yli 1 700 asiantuntijaa, toimihenkilöä ja johtajaa, joista lähes puolet arvioi, että kone voi olla ihmistä tasa-arvoisempi johtaja. Yhteensä 38 prosenttia uskoi algoritmisella johtamisella olevan positiivinen vaikutus urakehitykseen (Valkama 2025). Tärkein perustelu ei kuitenkaan ollut tekninen, vaan sosiaalinen.

Monet katsovat koneen perustavan päätöksensä dataan henkilökohtaisten suhteiden sijaan. Tulos kertoo jotain olennaista siitä, miten huonosti ihmisjohtaminen on monissa organisaatioissa onnistunut. Kun alaiset toivovat konetta esihenkilönsä tilalle, kyse ei ole teknologiafetissistä, vaan pettymyksestä työelämään, joka pitää sisällään niin kutsuttuja kultapossukerhoja eli suosikkijärjestelmiä, läpinäkymättömiä ylennysperusteita, epäreiluja palautekulttuureja sekä henkilöstöpulaa. Ei ihme, että etenkin moni nuori kokee kaikki samalle viivalle asettavat järjestelmät ihmisjohtajaa oikeudenmukaisemmiksi.

Tämä havainto on linjassa sen kanssa, mitä Rosenblat ja Stark (2016) dokumentoivat tutkimuksessaan Uber-kuljettajista. He osoittivat, että algoritminen järjestelmä loi näennäisen oikeudenmukaisuuden illuusion. Eräänlaisen tasapuolisuuden, joka houkutteli työntekijöitä, vaikka informaatioasymmetria todellisuudessa suosi aina alustan omistajaa (esim. Partington 2026). Luottamus algoritmiin ei siis aina tarkoita sitä, että järjestelmä on reilu, vaan että ihmisjohtaminen on pettänyt työntekijän luottamuksen tavalla tai toisella.

Monet Haaga-Helian kyselyyn vastanneista valitsevat silti selvästi mieluummin ihmisjohtajan kuin algoritmin. Esimerkiksi koneen ei haluta päättävän suoritusten asettamisessa ja arvioinnissa. Palkkioiden tasa-arvoisuudessa kone sen sijaan nähtiin ihmisjohtajan veroisena tai jopa hieman parempana. Ihmiset siis luottavat koneen puolueettomuuteen, mutta pelkäävät sen kylmyyttä ja kykyä arvioida ihmisen toimintaa.

Pohjimmiltaan kyse on tietoisesta työnjaosta. Algoritmit ovat hyviä siinä, missä data on tiheää ja kriteerit helposti mitattavia. Ihmiset puolestaan loistavat silloin, kun tilanteet vaativat tulkintaa, kontekstia ja empatiaa. Haaste on todennäköisesti siinä, että organisaatiot eivät aina tee tätä eroa. Tai vaihtoehtoisesti se tehdään taloudellisten paineiden ohjaamana ja täysin huomaamatta — ilman että kukaan on oikeastaan kysynyt, mitä me haluamme algoritmin tekevän, miksi, ja mitä sen ei pitäisi missään nimessä tehdä. Toisaalta ehkä kyse ei alun perinkään ole siitä, voiko algoritmiin luottaa, vaan siitä, voiko sitä hyödyntävään organisaatioon luottaa.

Kirjoittaja

Martti Asikainen

Communications Lead

+358 44 920 7374

martti.asikainen@haaga-helia.fi

Tämä kirjoitus on luotu osana Haaga-Helia ammattikorkeakoulun ja Työsuojelurahaston rahoittamia Kone johtajana- ja ReiluAI-hankkeita.

Lähteet

Ananny, M., & Crawford, K. (2018). Seeing without knowing: Limitations of the transparency ideal and its application to algorithmic accountability. New Media & Society, 20(3), 973–989.

Asikainen, M. & Lahtinen, A. (2025). Algorithmic management spreads across Finnish workplaces — younger workers show greater acceptance than their older colleagues. Haaga-Helia ammattikorkeakoulun lehdistötiedote. Julkaistu Haaga-Helia ammattikorkeakoulun verkkosivuilla 16. kesäkuuta 2025. Viitattu 26. huhtikuuta 2026.

Bansal, V. (2026). Amazon is determined to use AI for everything – even when it slows down work. Julkaistu The Guardianin sivuilla 11. maaliskuuta 2026. Viitattu 24. huhtikuuta 2026.

Bucher, T. (2018). If… then: Algorithmic power and politics. Oxford University Press. Oxford.

Carnegie, M. (2022). Gig Workers Are Getting Crushed by the Review Mill. Julkaistu The Wiredissä 15. joulukuuta 2022. Viitattu 24. huhtikuuta 2026.

Colquitt, J. A., Conlon, D. E., Wesson, M. J., Porter, C. O., & Ng, K. Y. (2001). Justice at the millennium: A meta-analytic review of organizational justice research. Journal of Applied Psychology, 86(3), 425–445.

Euroopan unioni (2024). Regulation (EU) 2024/1689 of the European Parliament and of the Council on artificial intelligence (AI Act). Official Journal of the European Union.

Kellogg, K. C., Valentine, M. A., & Christin, A. (2020). Algorithms at work: The new contested terrain of control. Academy of Management Annals, 14(1), 366–410.

Lee, M. K., Kusbit, D., Metsky, E., & Dabbish, L. (2015). Working with machines: The impact of algorithmic and data-driven management on human workers. Proceedings of the CHI Conference on Human Factors in Computing Systems, 1603–1612.

Levy, K. E. C. (2021). Book-smart, not street-smart: Blockchain-based smart contracts and the social workings of law. Engaging Science, Technology, and Society, 7, 1–15.

Meijerink, J., & Bondarouk, T. (2023). The duality of algorithmic management: Toward a research agenda. Human Resource Management Review.

OECD (2025). Algorithmic management in the workplace: New evidence from an OECD employer survey. OECD Publishing. Pariisi.

Palmer, A. (2020). How Amazon keeps a close eye on employee activism to head off unions. Julkaistu CNBC:n verkkosivuilla 24. lokakuuta 2020. Viitattu 28. huhtikuuta 2026.

Partington, R. (2026). Dynamic pay on platforms such as Uber should be banned, says TUC. Julkaistu The Guardianissa 3 toukokuuta 2026. Viitattu 3. toukokuuta 2026.

Rosenblat, A., & Stark, L. (2016). Algorithmic labor and information asymmetries: A case study of Uber drivers. International Journal of Communication, 10, 3758–3784.

Sainato, M. (2024). You feel like you’re in prison’: Workers Claim Amazon’s Surveillance Violates Labor Law. Julkaistu The Guardianissa 21. toukokuuta 2024. Viitattu 23. huhtikuuta 2026.

Valkama, H. (2025). ”Ei ennakkoasenteita eikä kaveripolitiikkaa” – Tekoäly nähdään ihmistä reilumpana johtajana. Julkaistu Ylen verkkosivuilla 23. syyskuuta 2025. Viitattu 26. huhtikuuta 2026.

Wood, A. J., Graham, M., Lehdonvirta, V., & Hjorth, I. (2019). Good gig, bad gig: Autonomy and algorithmic control in the global gig economy. Work, Employment and Society, 33(1), 56–75.